Кр вуз фпт

| Вид материала | Конспект |

- К вопросу о создании асу вуз: Проблемы создания и внедрения, 16.08kb.

- Программа : Учебная программа имеет модульную структуру и состоит из: обязательных, 93.82kb.

- Работа выполнена в научно-исследовательском секторе Школы-студии (вуз) им. Вл. И. Немировича-Данченко, 7376.04kb.

- Д. Е. Бурланков Все физические явления разворачиваются в пространстве с течением времени:, 268kb.

- В г. Ростове-на-Дону > I. Общие положения нир является одним из основных направлений, 69.33kb.

- Преемственность в обеспечении непрерывного экономического образования в системе «школа-ссуз-вуз», 463.36kb.

- Всероссийский конкурс «директор школы 2010» Принятие управленческих решений в организации, 816.08kb.

- Сегодня дпи нгту единственный в Нижегородском регионе вуз, где готовят инженеров химического, 79.68kb.

- Instituto Superior Tecnico крупнейший, наиболее престижный инженерный вуз Португалии,, 14.38kb.

- Гневашева В. А. Российский студент: социальный облик. По материалам мониторинга «Российский, 1950.72kb.

| Конспект лекций 2008 |

Колесников Л.П.

Компьютерная схемотехника

Рекомендуемая литература:

- В.И.Лачин, Н.С.Савёлов ЭЛЕКТРОНИКА, уч.п., Ростов-на Дону, «Феникс» 2007 . 697с.

- М.П.Бабич, І.А.Жуков Комп’ютерна схемотехніка, навч.посібник, МК-Прес, 2004, 412с.

- В.И.Бойко и др. Схемотехника электронных смстем. Цифровые устройства.СПб. 2004. 512с.

Содержание

| № лекции | № темы | Содержание темы | Стр. |

| 1 | 1 | Формы изображения информации.

| 3 |

| 2 | 1 |

| 9 |

| 3 | 1 |

| 15 |

| 4 | 2 | Схемотехника логических элементов

| 19 |

| 5 | 2 |

| 27 |

| 6 | 3 | Схемотехника цифровых элементов

| 33 |

| 7 | 3 |

| 41 |

| 8 | 4 | Схемотехника основных узлов комбинационных схем

| 49 |

| 9 | 4 |

| 55 |

| 10 | 5 | Схемотехника основных узлов цифровых схем

| 59 |

| 11 | 5 |

| 65 |

| 12 | 5 |

| 71 |

Лекция 1

Тема 1: Формы изображения информации

План лекции:

- Определение и классификация информации

- Измерение количества информации

- Кодирование символьной информации

Понятие «информация» является таким же фундаментальным, как понятия «материя», «энергия» и другие философские категории. Это атрибут, свойство сложных систем, связанное с их развитием и самоорганизацией. Известно большое количество различных определений информации, отличие информации от данных, знаний и пр. Мы здесь ограничимся только рассмотрением некоторых практически важных понятий и определений.

1. Определение и классификация информации

1.1. Информатика, информация, сигналы и их представление

Широкое применение компьютеров содействует научно-техническому развитию страны. Сфера использования компьютеров охватывает практически все виды человеческой деятельности.

Компьютер — это программно управляемая физическая система, предназначенная для алгоритмической проработки информации, поданной сигналами.

В широком значении слова информация является отпечатком реального мира. Информация — это единственный ресурс жизнеобеспечения, которое не уменьшается. Более того: ее объем в данное время удваивается ежегодно.

Информация, подготовленная для проработки на компьютерах, называется данными.

Информационный процесс включает у себя такие этапы:

- сбор информации от разнообразных источников и представления ее в форме необходимой для введения в компьютер;

- передачу (пересылку) информации от источника к приемнику;

- хранение — процесс передачи информации во времени;

- обработка — систематическое выполнение операций над данными;

- выдачу результата проработки пользователю.

На всех этих этапах используют средства компьютерной схемотехники. К информации предъявляют такие требования:

- корректность (однозначность восприятия);

- ценность (полезность) и оперативность (актуальность);

- точность, достоверность и стойкость (возможность реагировать на смены начальных данных);

- достаточность (полнота) — наличие минимально необходимого объема информации для принятия правильного решения.

Структуру и общие свойства информационных процессов изучают в информатике, которая содержит:

- теорию информации;

- алгоритмические, программные и компьютерные средства обработки информации;

- архитектуру компьютеров, системы искусственного интеллекта, вычислительные сети и др.

В теории информации изучают процессы передачи, превращения и хранения информации, куда входят:

• методы определения количества информации в сообщении;

- рациональные средства представления информации с помощью разнообразных символов (букв, цифр и др.);

- средства формирования, выявления и оценки параметров информационных процессов.

Упорядоченную последовательность символов (букв, цифр, математических знаков, предназначенных для передачи информации), закодированную в материальной форме, называют сообщением.

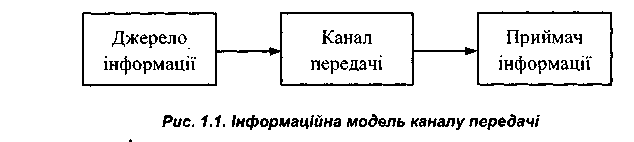

Информационное сообщение всегда связано с источником и приемником информации, соединенными каналом передачи (рис. 1.1).

Рис. 1.1 Информационная модель канала передачи

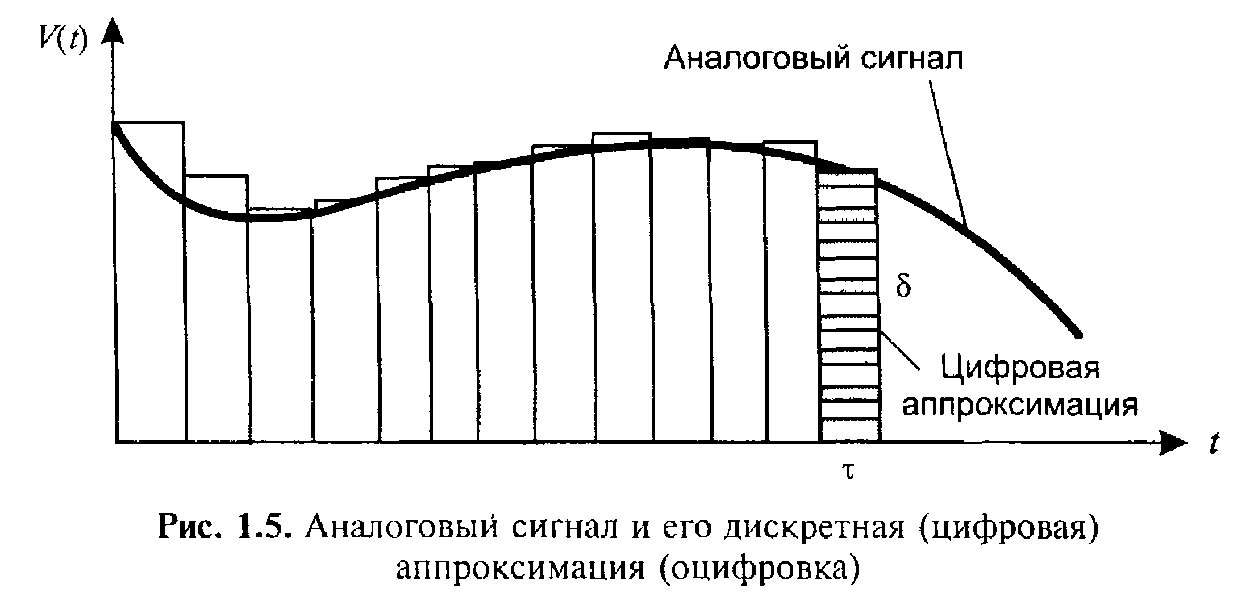

Исторически первой технологической формой получения, передачи, хранения информации являлось аналоговое (непрерывное) представление звукового, оптического, электрического или другого сигнала (сообщения). Магнитная аудио- и видеозапись, фотографирование, запись на шеллачные или виниловые грампластинки, проводное и радиовещание — основные способы хранения и передачи информации в аналоговой форме (рис. 1.2).

Рис.1.2 Аналоговый сигнал и его дискретная (цифровая) аппроксимация (оцифровка)

Аналого-цифровое (дискретное) преобразование — АЦП (analog-to-digital conversion) заключается в формировании последовательностей n-разрядных двоичных слов, представляющих с заданной точностью аналоговые сигналы. Для выполнения этого преобразования вначале осуществляется квантование аналогового сигнала. В результате преобразования получается дискретный сигнал.

Наименьшее изменение аналогового сигнала, которое регистрируется устройством, осуществляющим преобразование, называется разрешением.

Аналого-дискретные преобразователи чаще всего изготавливаются в виде интегральных схем. В необходимых случаях осуществляется обратное — дискретно-аналоговое (цифро-аналоговое преобразование — ЦАП).

Дискретный сигнал — сигнал, имеющий конечное, обычно небольшое, число значений.

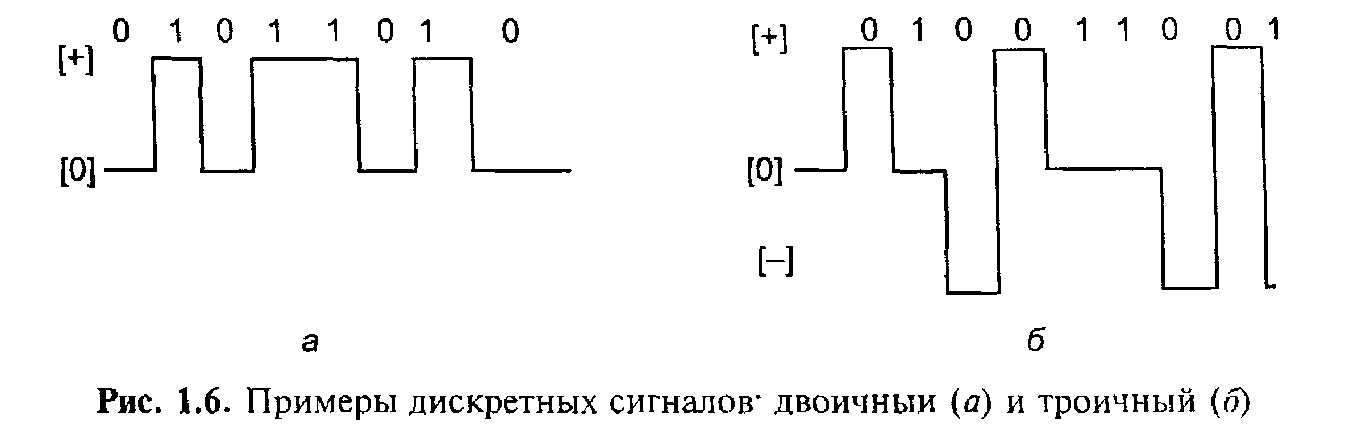

Практически всегда дискретный сигнал имеет два либо три значения. Нередко его называют также цифровым сигналом.

В цифровых системах используются двоичные сигналы (рис.1.3, а), имеющие значения:

(+) или (-).

Вместе с тем при передаче данных в большинстве случаев применяются троичные сигналы (рис. 1.3, б) со значениями: (+), (0), (-).

Рис.1.3 Примеры дискретных сигналов: двоичный (а) и троичный (б).

Здесь «единица» представляется отсутствием потенциала в канале, тогда как «нуль» характеризуется положительным либо отрицательным импульсом. При этом полярность импульсов, представляющих «нули», должна чередоваться, т. е. за положительным (+) импульсом должен следовать отрицательный (-) и наоборот. В форме троичного сигнала осуществляется не только кодирование передаваемых данных, но также обеспечивается синхронизация работы канала и проверка целостности данных.

Дискретные сигналы, по сравнению с аналоговыми, имеют ряд важных преимуществ: помехоустойчивость, легкость восстановления формы, простота аппаратуры передачи.

1.2 Измерение количества информации

В качестве единицы информации Клод Шеннон предложил принять один бит (англ, bit - binary digit — двоичная цифра).

Бит в теории информации - количество информации, необходимое для различения двух равновероятных сообщений или «орел - решка», «чет - нечет» и т. п.

В вычислительной технике битом называют наименьшую «порцию» памяти компьютера, необходимую для хранения одного из двух знаков 0 и 1, используемых для машинного представления данных и команд.

За единицу информации можно было бы выбрать количество информации, необходимое для различения, например, десяти равновероятных сообщений. Это будет не двоичная (бит), а десятичная (дит) единица информации.

Поскольку бит — слишком мелкая единица измерения, на практике чаще применяется более крупная единица — байт, равная восьми битам.

В частности, восемь бит требуется для того, чтобы закодировать любой из 256 символов основного компьютерного кода ASCII (256 = 28).

Используются также более крупные производные единицы информации:

Килобайт (Кбайт) - 1024 байт = 210 байт;

Мегабайт (Мбайт) - 1024 Кбайт = 220 байт;

Гигабайт (Гбайт) - 1024 Мбайт = 230 байт.

В последнее время в связи с увеличением объемов обрабатываемой информации входят в употребление такие производные единицы, как:

Терабайт (Тбайт) - 1024 Гбайт = 240 байт;

Петабайт (Пбайт) - 1024 Тбайт =250 байт;

Экзобайт (Эбайт) - = 1018 Мбайт и пр.

Для описания скорости передачи данных можно использовать термин бод.

Число бод равно количеству значащих изменений сигнала (потенциала, фазы, частоты), происходящих в секунду. Первоначально бод использовался в телеграфии. Для двоичных сигналов нередко принимают, что бод равен биту в секунду, например 1200 бод = 1200 бит/с.

Однако единого мнения о правильности использования этого термина нет, особенно при высоких скоростях, где число бит в секунду не совпадает с числом бод.

1.3 Кодирование символьной информации

Код (code) — совокупность знаков, символов и правил представления информации.

В частности, можно различать двоичный и троичный код. Алфавит первого ограничен двумя символами (0, 1), а второго — тремя символами (-1, 0, +1). Сигналы, реализующие коды, обладают одной из следующих характеристик:

- униполярный код (значения сигнала равны 0, +1, либо 0, -1);

- полярный код (значения сигнала равны -1, +1);

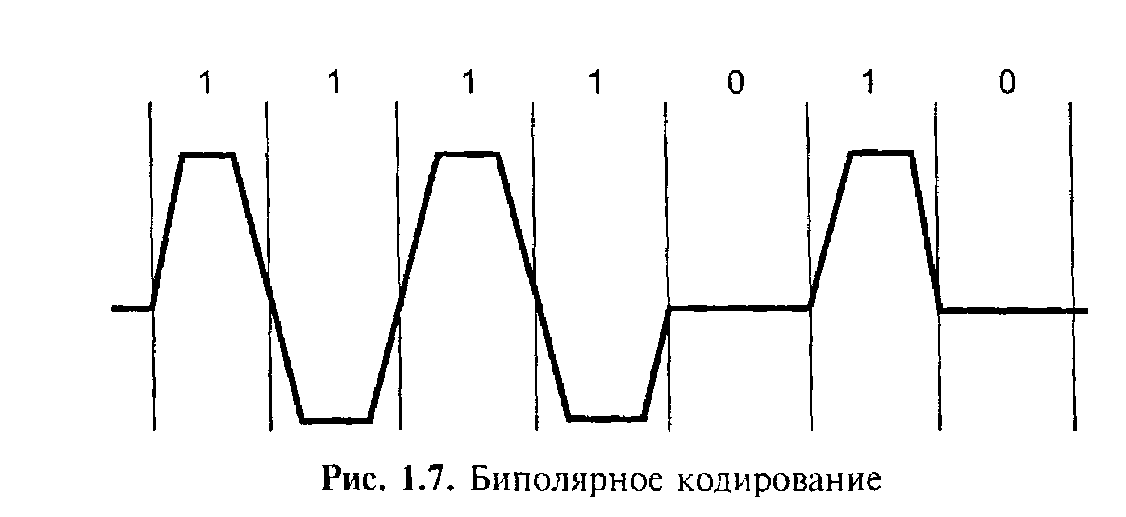

- биполярный код (значения равны -1, 0, +1).

Биполярные коды часто используются в каналах передачи данных (рис. 1.7). Здесь единицы представляются чередующимися положительными и отрицательными импульсами. Отсутствие импульсов определяет состояние «нуль».

Биполярное кодирование обеспечивает обнаружение одиночной ошибки. Так, если вместо нуля появится единица, либо единица ошибочно сменится на нуль, то это легко обнаруживается. В обоих случаях нарушается чередование полярности импульсов.

Рассмотрим методы дискретного представления информации, или кодирования (которые, надо сказать, появились задолго до вычислительных машин).

Первым широко известным примером является Азбука Морзе, в которой буквы и цифры кодируются сочетаниями из «точек» и «тире».

Кодируемые (обозначаемые) элементы входного алфавита обычно называют символами

Символом (служит условным знаком какого-нибудь понятия, явления) как правило, является цифра, буква, знак пунктуации или иероглиф естественного языка, знак препинания, знак пробела, специальный знак, символ операции. Кроме этого, учитываются управляющие («непечатные») символы.

Кодирующие (обозначающие) элементы выходною алфавита называются знаками, количество различных знаков в выходном алфавите назовем значностью количество знаков в кодирующей последовательности для одного символа — разрядностью кода.

Последовательным кодом является такой, в котором знаки следуют один за другим во времени (например, радио- или оптические сигналы либо передача по двум проводам, 2-жильному кабелю).

Параллельным кодом является тот, в котором знаки передаются одновременно образуя символ (например, по четырем проводам, 4-жильному кабелю т. е. символ передается в один прием, в один момент времени).

Применительно к азбуке Морзе (AM).

- символами являются элементы языкового алфавита (буквы A—Z или А—Я) и цифровой алфавит (здесь — цифры 0—9);

- знаками — «точка» и «тире» (или «+» и «-» либо «1» и «0», короче — два любых разных знака);

- поскольку знаков два (точка и тере), AM является двузначным (бинарным, двоичным) кодом, а если бы их было три, то мы имели бы дело с троичным, тернарным, трехзначным кодом;

• поскольку число знаков в AM колеблется от 1 (буквы Е, Т) до 5 (цифры), здесь имеет место код с переменной разрядность.

Поскольку знаки передаются последовательно (электрические импульсы, звуковые или оптические сигналы разной длины, соответствующие «точкам» и «тире»), AM есть последовательный код.

Первые опыты телеграфной и радиосвязи осуществлялись именно посредством AM, причем приемное устройство записывало импульсы переменной длины в виде «точек» и «тире» на движущуюся телеграфную ленту, однако уже в начале XX в. был осуществлен переход на 5-разрядный (5-битовый) телеграфный код.

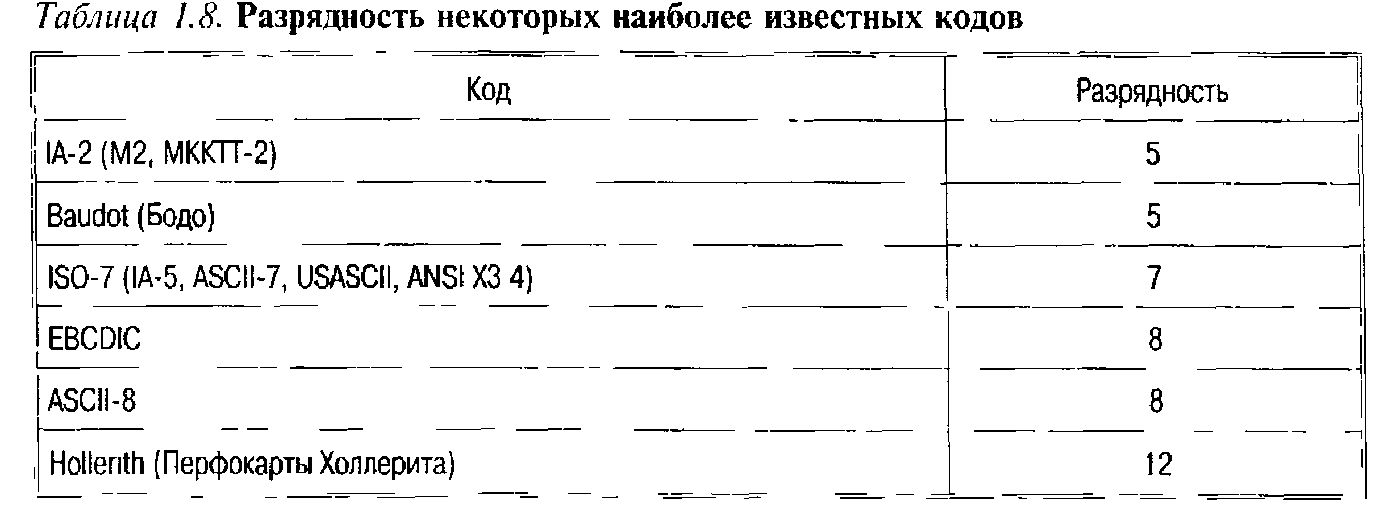

В табл. 1.8 приводится перечень наиболее известных кодов, некоторые из них использовались первоначально для связи, кодирования данных, а затем для представления информации в ЭВМ:

- код Бодо (IA-1 — international alphabet #1) — 5-разрядный код, бывший в прошлом европейским стандартом для телеграфной связи;

- М-2 (российское обозначение) или IА-2 (международное обозначение) — телеграфный код, предложенный Международным Комитетом по телефонии и телеграфии (МККЛТ) и заменивший код Бодо;

- ASCII (American Standard Code for Information Interchange) —стандартный 7-битовый код для передачи данных, поддерживает 128 символов, включающих заглавные и строчные символы латиницы, цифры, специальные значки и управляющие символы. Этот код, к которому были добавлены некоторые национальные символы (10 бинарных комбинаций), был принят Международной организацией по стандартизации (ISO) как стандарт ISO-7;

- EBCDIC (Expanded Binary Coded Decimal Interchange Code) 8-разрядный код, предложенный фирмой IBM для машин серий IBM/360-375 (внутреннее представление данных в памяти), а затем распространившийся и на системы других производителей;

- ASCII-8 — 8-разрядный код, принятый для внутреннего и внешнего представления данных в вычислительных системах. Включает стандартную часть (128 символов) и национальную (128 символов);

- код Холлерита, предложенный для ПК (1913г.), затем использовавшийся для кодирования информации перед вводом в ЭВМ с перфокарт.

Одним из «последних слов» в процессе развития систем символьного кодирования является универсальный код UNICODE (UNIversal CODE) — стандарт 16-разрядного кодирования символов.

Стандарт UNICODE разработан техническим комитетом, в который вошли представители ряда ведущих фирм. Он определяет коды, обеспечивающие идентификацию различных символов: букв, иероглифов, цифр и т. д. Код может использоваться вместо 7—8-битовых, в том числе и ASCII. Поскольку в 16-разрядном UNICODE можно закодировать 65 536 символов вместо 128 в ASCII, то отпадает необходимость в создании модификации таблиц кодов. Это существенно упрощает обработку текстовых файлов, хотя и несколько увеличивает их размеры

UNICODE охватывает 28 000 букв, знаков, слогов, иероглифов национальных языков мира и 30 000 мест в UNICODE зарезервировано. Использование этого резерва дает возможность пользователям вводить математические или технические символы, а также создавать свои собственные символы.

Единая стандартизация языковых форматов наводит порядок в международном кодировании алфавитов различных языков. Здесь учтено также то, что в таких языках, как иврит и арабский, текст пишется справа налево.

При передаче данных часто используются избыточные коды, т. е. такие, которые за счет усложнения структуры позволяют повысить надежность передачи данных. К ним, в первую очередь, относятся коды с обнаружением ошибок. Чаще всего это циклические избыточные коды. Простая разновидность такого кода — код с контролем по четности.

Широко используется для обнаружения ошибок в блоках данных также код контроля циклической избыточности CRC. Он определяется на основе содержимого блока данных перед его передачей, включается в одно из полей блока, а затем повторно вычисляется после передачи. Несовпадение результатов свидетельствует об ошибке в передаваемом содержимом.

Важное значение имеют коды с исправлением ошибок. Использование этих кодов позволяет с большой вероятностью не только обнаруживать, но и исправлять возникшие при передаче ошибки (код Хемминга, позволяющий исправлять одиночные ошибки, появляющиеся в блоках данных).

Контрольные вопросы.

1. Как вы понимаете, что такое информация.

2. Расскажите, как вы понимаете, что такое аналоговый сигнал и способы его преобразования.

3. Расскажите, что такое дискретный сигнал, и какие значения он может принимать.

4. Какие сигналы используются в цифровых системах.

5. Расскажите о единице измерения информации бит и о других единицах измерения.

6. Какие виды кодирования вы знаете, и как они характеризуются.

7. Перечислите известные вам коды.

8. Чем отличаются разные виды кодов.

9. Что такое избыточный код и его разновидности.

10.Какие единицы измерения информации вы знаете. Перечислите их и их производные.

Лекция 2